GPT-Realtime-Translateで桃太郎を5言語に翻訳!「どんぶらこ」「きびだんご」はどう訳された?

GPT-Realtime-Translateで桃太郎を5言語に翻訳!「どんぶらこ」「きびだんご」はどう訳された?

こんにちは!VISKの藤田です!!

2026年5月7日にOpenAIから新しいリアルタイム音声翻訳モデル「GPT-Realtime-Translate」がリリースされました。料金は $0.034/分(約5円/分) という衝撃価格。

「これは試さな」と思い立ち、題材として桃太郎の昔話を使って多言語翻訳の実力を検証してみました。

ただし、検証は想像の3倍くらい大変でした。後半でその苦労話もお伝えします。

この記事でわかること

GPT-Realtime-Translateを実際に使ってみた感想

桃太郎を5言語以上で翻訳した結果

日本語入力で発生した3つの不具合パターン

検証にかかった実費

AI技術検証のリアルな大変さ

検証環境

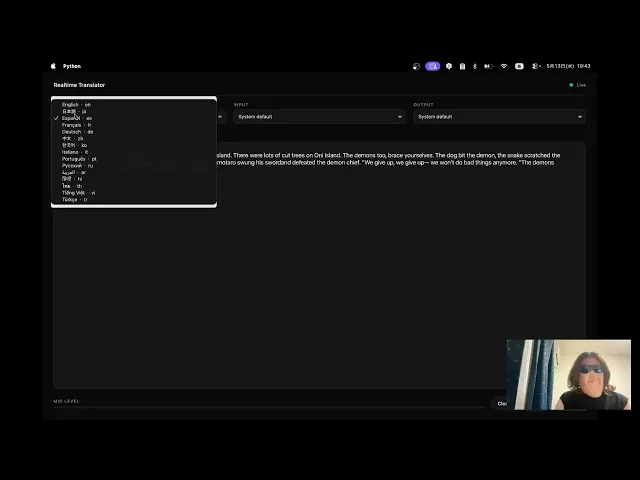

今回はOSS「mtg-realtime-translator」を使用しました。Zoom/Google Meet対応のリアルタイム翻訳アプリで、GPT-Realtime-Translateを内部で呼び出してくれます。

構成

翻訳エンジン: OpenAI GPT-Realtime-Translate

アプリ: mtg-realtime-translator(Python製)

録画ツール: OBS Studio

音声ルーティング: BlackHole 2ch(仮想オーディオデバイス)

PC: MacBook Air

検証方法

桃太郎の物語を章ごとに違う言語に切り替えながら音読し、翻訳結果を観察しました。

切り替えた言語は以下:

英語(English)

韓国語(한국어)

中国語(中文)

イタリア語(Italiano)

スペイン語(Español)

アラビア語(العربية)

検証結果1:多言語翻訳の実力

まずは実際の翻訳の様子をご覧ください。

🎥 動画①:多言語翻訳の本編

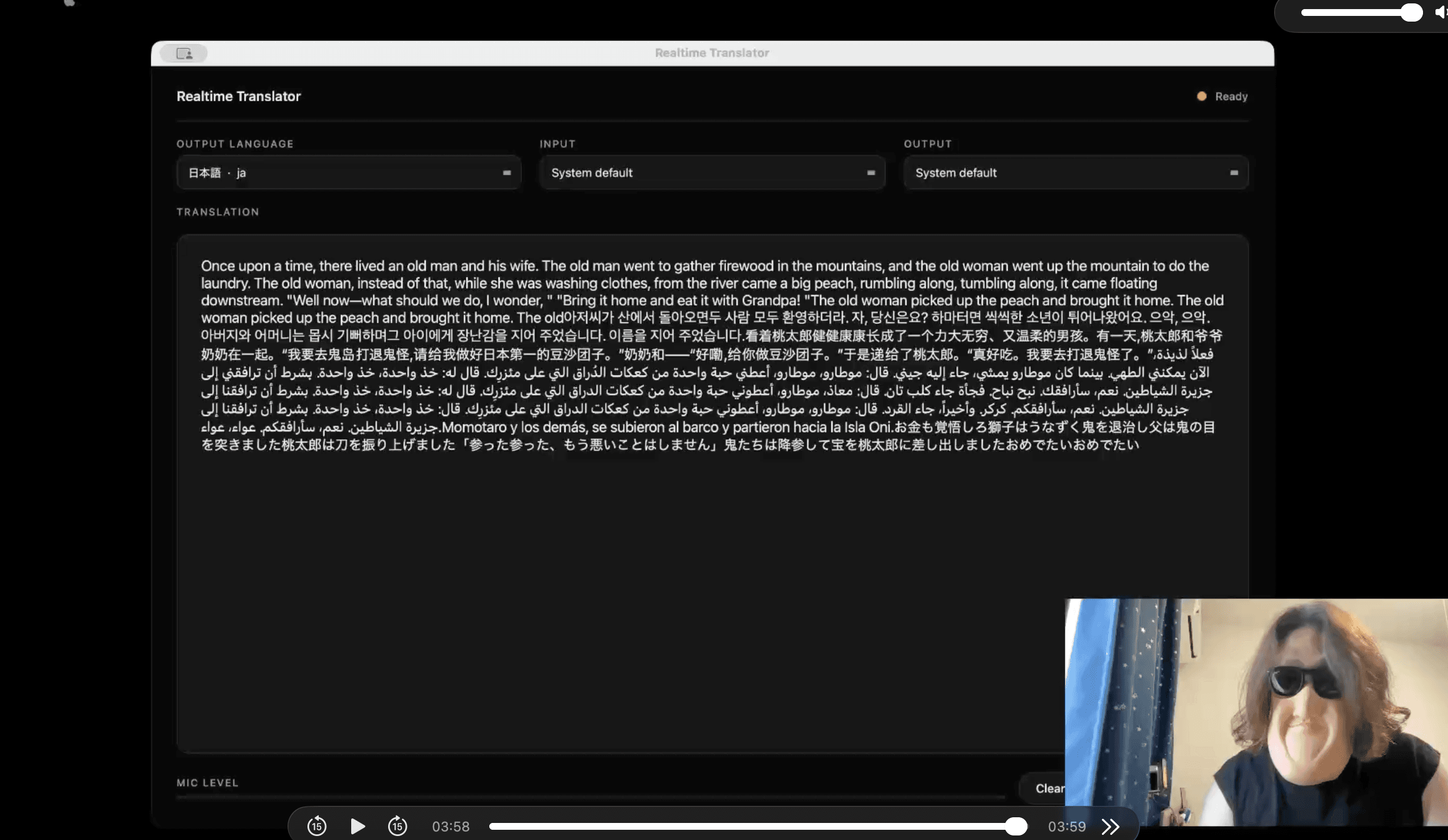

物語を最後まで翻訳した最終的な画面が以下です:

英語、韓国語、中国語、イタリア語、スペイン語、アラビア語が混在しており、それぞれの言語特性が見て取れます。

検証結果2:翻訳の見せ場

「どんぶらこ」の意訳が秀逸

桃太郎といえばこの擬音語。AIがどう訳すか一番気になっていたポイントです。

結果:

「bobbing along(揺れながら)」+「splash, splash(バシャバシャ)」の組み合わせで、擬音語のニュアンスをちゃんと表現できています。直訳ではなく意訳のセンスがあるのが意外でした。

「きびだんご」の訳し分け

各言語でどう訳されるか比較してみました:

言語 | 訳 |

|---|---|

英語 | millet dumplings |

中国語 | 桃团子 / 豆沙团子 |

韓国語 | 키비단고 / 기리단고 |

イタリア語 | dangō arrosto |

英語は**「millet dumplings(雑穀の団子)」と材料まで踏み込んで翻訳。一方、韓国語は「kibidango」をそのまま音訳**しているのが面白いポイントです。

「めでたし、めでたし」が詩的に

物語の締めくくり、AIはこう訳しました:

「Happily ever after」みたいな定型句ではなく、**「such good fortune, such good fortune」**と詩的な訳になっています。物語のトーンを汲んでいる感じがして好印象でした。

「鬼の親分」が階級表現される

「鬼の親分」を**"demon chief"と訳していて、ただの「rival」とか「boss」ではなく階級・組織性を含んだ訳**になっているのが印象的でした。

検証結果3:多言語の見え方

同じ物語が言語によってこれだけ印象が変わるのか、と驚いた部分です。

英語

最も自然で違和感のない翻訳。童話特有の言い回しもしっかり再現されていました。

韓国語

固有名詞の処理が興味深い結果に。

「桃太郎」→ 모모타로 または 엄마토(表記揺れあり)

「きびだんご」→ 키비단고(音訳)

中国語

漢字が残るため原文と比較しやすいのがメリット。「桃太郎」「鬼」「桃」などの漢字がそのまま残るので、視覚的に対応関係がわかりやすい翻訳でした。

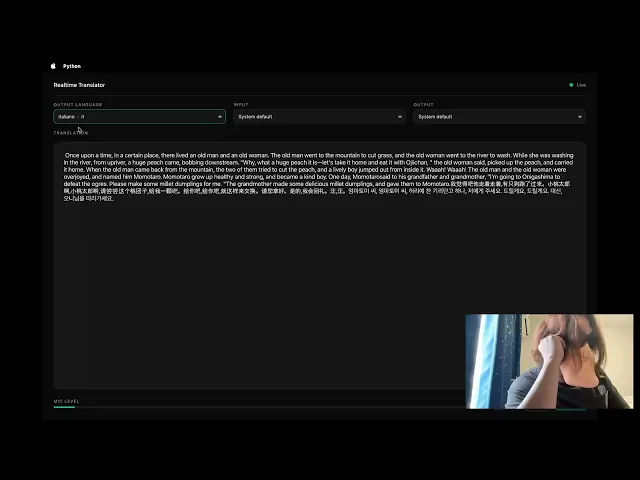

イタリア語

「porti dei dangō arrosto(焼いた団子を持って)」のように、「kibidango」をローマ字表記にしている点が他言語と異なります。

スペイン語

「鬼ヶ島」→ "Isla Oni" とローカライズされていました。「Oni」を固有名詞として扱いつつ、「Isla(島)」だけスペイン語化するハイブリッド訳が興味深いです。

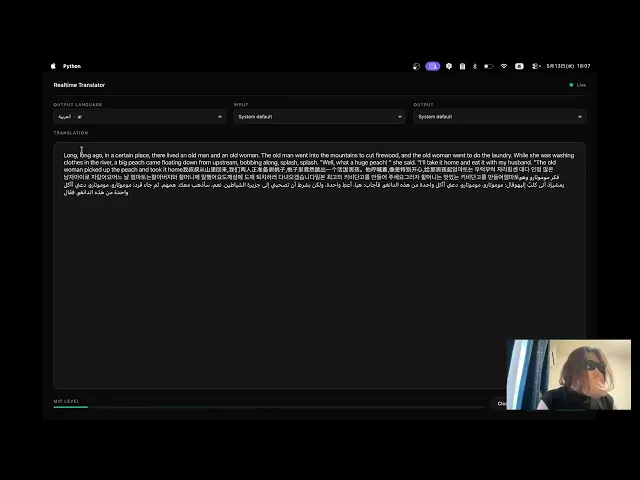

アラビア語

文字体系が漢字・ひらがな・カタカナからアラビア文字に切り替わると、視覚的なインパクトが強烈です。

「桃太郎」→ موموتارو(音訳)

「鬼ヶ島」→ جزيرة الشياطين(直訳:悪魔の島)

固有名詞の音訳と、地名の意訳が混在しているのが面白いポイントでした。

検証結果4:日本語の壁

ここからが今回の検証で最も興味深かった発見です。

日本語入力で3つの異なる不具合パターンが観察されました。動画と一緒にご覧ください。

パターン①:文字は出るが音声が出ない

英語から日本語に切り替えた時に発生した現象です。

画面上のテキストはちゃんと翻訳されているのに、スピーカーからは何も流れません。Realtime APIの音声合成パイプラインが日本語のみ動作しなかった可能性があります。

パターン②:文字も音声も出ない

日本語に切り替えた瞬間、翻訳機能そのものが停止するパターンです。

これは入力(日本語)と出力(日本語)が同じになることが原因と考えられます。Realtime Translateは異言語間の翻訳に特化しているため、同言語の音声処理は想定外の挙動になるようです。

パターン③:日本語パートだけ取得できない

英語→日本語→英語と切り替えた時、日本語のセクションだけ翻訳されない現象です。

英語パートは前後とも正常に翻訳されているため、日本語入力の処理に固有の問題があると推測されます。

考察

3つのパターンに共通するのは「日本語入力」がトリガーになっている点です。

想定用途は異言語間翻訳:日本語→他言語、他言語→日本語が本来の使い方

同言語処理は想定外:日本語→日本語のような同言語処理は不安定になりやすい

音声と文字で挙動が違う:文字認識は通っても音声合成が止まる場合がある

実運用で日本語をメインに使う場合は、出力言語を明確に異言語に設定することが必要そうです。

検証結果5:その他の技術的課題

1. 言語切り替えのタイミング

物語を読んでいる最中に出力言語を切り替えると、翻訳が一旦停止します。

これがなかなか厄介で、「どこまで翻訳されているか」が分からないので、切り替えるタイミングを掴めません。ライブ配信や同時通訳のような用途で使うには、UI側で工夫が必要そうです。

2. 長時間使用で品質劣化

30分以上使い続けると、音声認識の精度が落ちる感覚がありました。動画①でも途中から音声が悪くなったため、クリアに翻訳できた部分のみカットしています。

定期的にアプリを再起動して新セッションで使うのがおすすめです。

3. 60分セッション上限

Realtime APIは1セッション最大60分で自動切断されます。長時間の会議などで使う場合は、セッションを跨ぐ仕組みを実装する必要があります。

検証してみての本音:これがリアルに大変だった

ここからは技術記事というより検証日記に近い内容です。

「やってみた系」記事ではあまり書かれない生々しい苦労を共有します。同じようにAI検証する方の参考になれば。

体調と滑舌の壁

検証日、ちょうど風邪気味で声があまり出ない状態でした。さらにマスクを着けたまま音読していたので、声がこもります。普段から滑舌に自信があるわけでもなく、話者側のコンディションが翻訳精度に直撃することを実感しました。

カスカスのこもった声を必死に聞き取ろうとしてくれたGPT-Realtime-Translateにも、なかなか苦労をかけたと思います🙏

GPT-Realtime-Translateの問題ではなく、音声入力AI全般の課題ですね。ノイズや不明瞭な発音は素直に認識精度に出ます。

音声ルーティングの沼

ブログ用に録画もしようとして、ここから本格的に沼にハマります。

最初の状態:

自分の声と翻訳音声の両方が録画に入って二重に聞こえる

何を喋っているか聞き取りにくい

マイクをミュートしてみる:

自分の声は消えた

でも途中で翻訳音声も録音されなくなる

ここで「OBSの『画面キャプチャ』経由でシステム音声を録るのは限界がある」と気づきます。Macのシステム音声を安定してOBSに流すには、仮想オーディオデバイスが必要らしい。調べると「BlackHole」というツールが定番だと分かりました。

BlackHole(仮想オーディオデバイス)を導入:

翻訳音声をシステム経由でOBSに流す設定

結局また音声が二重に

「画面」キャプチャの音声を切ってみる:

今度は画面側が古いRealtime Translatorの表示を映しっぱなしになる現象が発生

結局録画素材として使えない

この試行錯誤を繰り返している間に、60分セッション上限に何度も到達。そのたびに「Your session hit the maximum duration of 60 minutes」のメッセージとともにアプリ再起動。撮り直し。マスク蒸れる。

一番堪えた瞬間

「やっといい録画が撮れた!」と思って再生してみたら、自分の声しか入っていなかった時。これが一番堪えました。

技術ブログでは「BlackHoleを使えばOK」みたいに1行で済まされる設定ですが、実際には音量ルーティング・OBSのソース設定・システム出力先の3つを正しく組み合わせないと動きません。

学び

音声検証は事前に短時間でテスト録画→再生確認を習慣化する

長尺撮影は60分上限を意識して計画する

マスクや風邪は翻訳精度に影響するので、体調万全の日に検証する

OBSのプレビューが映っていても、録画ファイルに入ってるとは限らない

検証の難しさは、技術そのものよりも周辺環境のセットアップにあると痛感した一日でした。

費用感

今回の検証で使った金額は以下の通り:

項目 | 金額 |

|---|---|

初回クレジット購入 | $11.00(税込) |

実際の使用量 | 約$2〜3 |

4時間以上アプリを起動して何度も録画し直しても、消費は$3に届きませんでした。

GPT-Realtime-Translateの**$0.034/分**という価格は、リアルタイム翻訳としては破格です。従来の翻訳パイプライン(音声認識→翻訳→音声合成)を構築するコストを考えると、圧倒的に安いと感じました。

まとめ:使いどころと注意点

向いている用途

異言語間のリアルタイム翻訳(本来の用途)

短時間のミーティングや商談

多言語対応のデモ・プロトタイプ

注意すべき点

日本語→日本語など同言語処理は不安定

長時間連続使用は品質劣化のリスク

言語切り替えのタイミングは慎重に

話者の発音・体調が翻訳精度に影響

録画用の音声ルーティングは事前検証必須

個人的な感想

価格対性能は素晴らしいの一言。「どんぶらこ」を擬音語として意訳できる翻訳精度には正直驚きました。

一方で、日本語入力で3パターンの不具合が観察されたように、実運用に持っていくには用途を見極めた検証が必要だと感じました。

Zoomの吹き替え、海外クライアントとの商談、社内勉強会の多言語化など、活用シーンはたくさん思い浮かびます。

VISKでも今後、海外クライアント対応や多言語ミーティングの場面でGPT-Realtime-Translateの活用を検討していこうと思います。

それでは、また次の検証記事で。

こんにちは!VISKの藤田です!!

2026年5月7日にOpenAIから新しいリアルタイム音声翻訳モデル「GPT-Realtime-Translate」がリリースされました。料金は $0.034/分(約5円/分) という衝撃価格。

「これは試さな」と思い立ち、題材として桃太郎の昔話を使って多言語翻訳の実力を検証してみました。

ただし、検証は想像の3倍くらい大変でした。後半でその苦労話もお伝えします。

この記事でわかること

GPT-Realtime-Translateを実際に使ってみた感想

桃太郎を5言語以上で翻訳した結果

日本語入力で発生した3つの不具合パターン

検証にかかった実費

AI技術検証のリアルな大変さ

検証環境

今回はOSS「mtg-realtime-translator」を使用しました。Zoom/Google Meet対応のリアルタイム翻訳アプリで、GPT-Realtime-Translateを内部で呼び出してくれます。

構成

翻訳エンジン: OpenAI GPT-Realtime-Translate

アプリ: mtg-realtime-translator(Python製)

録画ツール: OBS Studio

音声ルーティング: BlackHole 2ch(仮想オーディオデバイス)

PC: MacBook Air

検証方法

桃太郎の物語を章ごとに違う言語に切り替えながら音読し、翻訳結果を観察しました。

切り替えた言語は以下:

英語(English)

韓国語(한국어)

中国語(中文)

イタリア語(Italiano)

スペイン語(Español)

アラビア語(العربية)

検証結果1:多言語翻訳の実力

まずは実際の翻訳の様子をご覧ください。

🎥 動画①:多言語翻訳の本編

物語を最後まで翻訳した最終的な画面が以下です:

英語、韓国語、中国語、イタリア語、スペイン語、アラビア語が混在しており、それぞれの言語特性が見て取れます。

検証結果2:翻訳の見せ場

「どんぶらこ」の意訳が秀逸

桃太郎といえばこの擬音語。AIがどう訳すか一番気になっていたポイントです。

結果:

「bobbing along(揺れながら)」+「splash, splash(バシャバシャ)」の組み合わせで、擬音語のニュアンスをちゃんと表現できています。直訳ではなく意訳のセンスがあるのが意外でした。

「きびだんご」の訳し分け

各言語でどう訳されるか比較してみました:

言語 | 訳 |

|---|---|

英語 | millet dumplings |

中国語 | 桃团子 / 豆沙团子 |

韓国語 | 키비단고 / 기리단고 |

イタリア語 | dangō arrosto |

英語は**「millet dumplings(雑穀の団子)」と材料まで踏み込んで翻訳。一方、韓国語は「kibidango」をそのまま音訳**しているのが面白いポイントです。

「めでたし、めでたし」が詩的に

物語の締めくくり、AIはこう訳しました:

「Happily ever after」みたいな定型句ではなく、**「such good fortune, such good fortune」**と詩的な訳になっています。物語のトーンを汲んでいる感じがして好印象でした。

「鬼の親分」が階級表現される

「鬼の親分」を**"demon chief"と訳していて、ただの「rival」とか「boss」ではなく階級・組織性を含んだ訳**になっているのが印象的でした。

検証結果3:多言語の見え方

同じ物語が言語によってこれだけ印象が変わるのか、と驚いた部分です。

英語

最も自然で違和感のない翻訳。童話特有の言い回しもしっかり再現されていました。

韓国語

固有名詞の処理が興味深い結果に。

「桃太郎」→ 모모타로 または 엄마토(表記揺れあり)

「きびだんご」→ 키비단고(音訳)

中国語

漢字が残るため原文と比較しやすいのがメリット。「桃太郎」「鬼」「桃」などの漢字がそのまま残るので、視覚的に対応関係がわかりやすい翻訳でした。

イタリア語

「porti dei dangō arrosto(焼いた団子を持って)」のように、「kibidango」をローマ字表記にしている点が他言語と異なります。

スペイン語

「鬼ヶ島」→ "Isla Oni" とローカライズされていました。「Oni」を固有名詞として扱いつつ、「Isla(島)」だけスペイン語化するハイブリッド訳が興味深いです。

アラビア語

文字体系が漢字・ひらがな・カタカナからアラビア文字に切り替わると、視覚的なインパクトが強烈です。

「桃太郎」→ موموتارو(音訳)

「鬼ヶ島」→ جزيرة الشياطين(直訳:悪魔の島)

固有名詞の音訳と、地名の意訳が混在しているのが面白いポイントでした。

検証結果4:日本語の壁

ここからが今回の検証で最も興味深かった発見です。

日本語入力で3つの異なる不具合パターンが観察されました。動画と一緒にご覧ください。

パターン①:文字は出るが音声が出ない

英語から日本語に切り替えた時に発生した現象です。

画面上のテキストはちゃんと翻訳されているのに、スピーカーからは何も流れません。Realtime APIの音声合成パイプラインが日本語のみ動作しなかった可能性があります。

パターン②:文字も音声も出ない

日本語に切り替えた瞬間、翻訳機能そのものが停止するパターンです。

これは入力(日本語)と出力(日本語)が同じになることが原因と考えられます。Realtime Translateは異言語間の翻訳に特化しているため、同言語の音声処理は想定外の挙動になるようです。

パターン③:日本語パートだけ取得できない

英語→日本語→英語と切り替えた時、日本語のセクションだけ翻訳されない現象です。

英語パートは前後とも正常に翻訳されているため、日本語入力の処理に固有の問題があると推測されます。

考察

3つのパターンに共通するのは「日本語入力」がトリガーになっている点です。

想定用途は異言語間翻訳:日本語→他言語、他言語→日本語が本来の使い方

同言語処理は想定外:日本語→日本語のような同言語処理は不安定になりやすい

音声と文字で挙動が違う:文字認識は通っても音声合成が止まる場合がある

実運用で日本語をメインに使う場合は、出力言語を明確に異言語に設定することが必要そうです。

検証結果5:その他の技術的課題

1. 言語切り替えのタイミング

物語を読んでいる最中に出力言語を切り替えると、翻訳が一旦停止します。

これがなかなか厄介で、「どこまで翻訳されているか」が分からないので、切り替えるタイミングを掴めません。ライブ配信や同時通訳のような用途で使うには、UI側で工夫が必要そうです。

2. 長時間使用で品質劣化

30分以上使い続けると、音声認識の精度が落ちる感覚がありました。動画①でも途中から音声が悪くなったため、クリアに翻訳できた部分のみカットしています。

定期的にアプリを再起動して新セッションで使うのがおすすめです。

3. 60分セッション上限

Realtime APIは1セッション最大60分で自動切断されます。長時間の会議などで使う場合は、セッションを跨ぐ仕組みを実装する必要があります。

検証してみての本音:これがリアルに大変だった

ここからは技術記事というより検証日記に近い内容です。

「やってみた系」記事ではあまり書かれない生々しい苦労を共有します。同じようにAI検証する方の参考になれば。

体調と滑舌の壁

検証日、ちょうど風邪気味で声があまり出ない状態でした。さらにマスクを着けたまま音読していたので、声がこもります。普段から滑舌に自信があるわけでもなく、話者側のコンディションが翻訳精度に直撃することを実感しました。

カスカスのこもった声を必死に聞き取ろうとしてくれたGPT-Realtime-Translateにも、なかなか苦労をかけたと思います🙏

GPT-Realtime-Translateの問題ではなく、音声入力AI全般の課題ですね。ノイズや不明瞭な発音は素直に認識精度に出ます。

音声ルーティングの沼

ブログ用に録画もしようとして、ここから本格的に沼にハマります。

最初の状態:

自分の声と翻訳音声の両方が録画に入って二重に聞こえる

何を喋っているか聞き取りにくい

マイクをミュートしてみる:

自分の声は消えた

でも途中で翻訳音声も録音されなくなる

ここで「OBSの『画面キャプチャ』経由でシステム音声を録るのは限界がある」と気づきます。Macのシステム音声を安定してOBSに流すには、仮想オーディオデバイスが必要らしい。調べると「BlackHole」というツールが定番だと分かりました。

BlackHole(仮想オーディオデバイス)を導入:

翻訳音声をシステム経由でOBSに流す設定

結局また音声が二重に

「画面」キャプチャの音声を切ってみる:

今度は画面側が古いRealtime Translatorの表示を映しっぱなしになる現象が発生

結局録画素材として使えない

この試行錯誤を繰り返している間に、60分セッション上限に何度も到達。そのたびに「Your session hit the maximum duration of 60 minutes」のメッセージとともにアプリ再起動。撮り直し。マスク蒸れる。

一番堪えた瞬間

「やっといい録画が撮れた!」と思って再生してみたら、自分の声しか入っていなかった時。これが一番堪えました。

技術ブログでは「BlackHoleを使えばOK」みたいに1行で済まされる設定ですが、実際には音量ルーティング・OBSのソース設定・システム出力先の3つを正しく組み合わせないと動きません。

学び

音声検証は事前に短時間でテスト録画→再生確認を習慣化する

長尺撮影は60分上限を意識して計画する

マスクや風邪は翻訳精度に影響するので、体調万全の日に検証する

OBSのプレビューが映っていても、録画ファイルに入ってるとは限らない

検証の難しさは、技術そのものよりも周辺環境のセットアップにあると痛感した一日でした。

費用感

今回の検証で使った金額は以下の通り:

項目 | 金額 |

|---|---|

初回クレジット購入 | $11.00(税込) |

実際の使用量 | 約$2〜3 |

4時間以上アプリを起動して何度も録画し直しても、消費は$3に届きませんでした。

GPT-Realtime-Translateの**$0.034/分**という価格は、リアルタイム翻訳としては破格です。従来の翻訳パイプライン(音声認識→翻訳→音声合成)を構築するコストを考えると、圧倒的に安いと感じました。

まとめ:使いどころと注意点

向いている用途

異言語間のリアルタイム翻訳(本来の用途)

短時間のミーティングや商談

多言語対応のデモ・プロトタイプ

注意すべき点

日本語→日本語など同言語処理は不安定

長時間連続使用は品質劣化のリスク

言語切り替えのタイミングは慎重に

話者の発音・体調が翻訳精度に影響

録画用の音声ルーティングは事前検証必須

個人的な感想

価格対性能は素晴らしいの一言。「どんぶらこ」を擬音語として意訳できる翻訳精度には正直驚きました。

一方で、日本語入力で3パターンの不具合が観察されたように、実運用に持っていくには用途を見極めた検証が必要だと感じました。

Zoomの吹き替え、海外クライアントとの商談、社内勉強会の多言語化など、活用シーンはたくさん思い浮かびます。

VISKでも今後、海外クライアント対応や多言語ミーティングの場面でGPT-Realtime-Translateの活用を検討していこうと思います。

それでは、また次の検証記事で。