「model=」を1行変えるだけ。ChatGPT・Claude・Geminiを自由に切り替えられるLiteLLMを試してみた

「model=」を1行変えるだけ。ChatGPT・Claude・Geminiを自由に切り替えられるLiteLLMを試してみた

「model=」を1行変えるだけ。ChatGPT・Claude・Geminiを自由に切り替えられるLiteLLMを試してみた

ChatGPT、Claude、Gemini——全部試したいけど、コード書き直すの面倒じゃないですか?

業務でAIを活用しようとすると、「結局どのモデルが一番いいの?」という疑問にぶつかります。OpenAIのGPT-4o、AnthropicのClaude、GoogleのGemini——得意分野もコストも違う。でも各社のSDKもAPIの書き方もバラバラで、比較するだけでもう一仕事。

「model=の文字列を変えるだけで、全部のAIを呼び出せたらいいのに」

それ、できます。

今回検証したのは LiteLLM。100種類以上のAIモデルを統一インターフェースで呼び出せるPythonライブラリです。実際に動かしてみたら、想像以上にシンプルだったので検証結果を共有します。

LiteLLMとは——AIモデルの「方言」を吸収してくれる翻訳機

ひとことで言うと、「1つのコードで100種類以上のAIモデルを呼び出せるPythonライブラリ」 です。オープンソースで無料。pip install litellm で入ります。

何がすごいかというと、AIモデルの切り替えが model= の1箇所を変えるだけで済むこと。

from litellm import completion # Claudeを使う response = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...]) # Geminiに切り替え(変えたのはこの1行だけ) response = completion(model='gemini/gemini-2.0-flash', messages=[...]) # ChatGPTに切り替え(やっぱりこの1行だけ) response = completion(model='openai/gpt-4o', messages=[...])

コードの構造はまったく同じ。変えるのは model= の文字列だけ。

これ、地味に見えて革命的じゃないですか。

セットアップ:5分で終わる(本当に)

やることは2つだけです。

① LiteLLMをインストール

② 使いたいAIのAPIキーを環境変数にセット

export ANTHROPIC_API_KEY="sk-ant-xxxxxxxxxxxxx" export GEMINI_API_KEY="xxxxxxxxxxxxx"

以上。 フレームワークの設定ファイルも、複雑な初期化コードも不要。

💡

exportで設定したAPIキーはターミナルを閉じるとリセットされます。永続化するなら.bashrcや.zshrcに書いておくのがおすすめです。

実際に動かしてみた

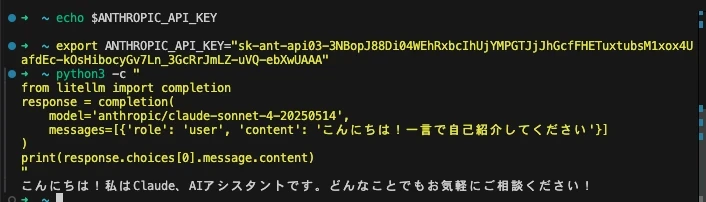

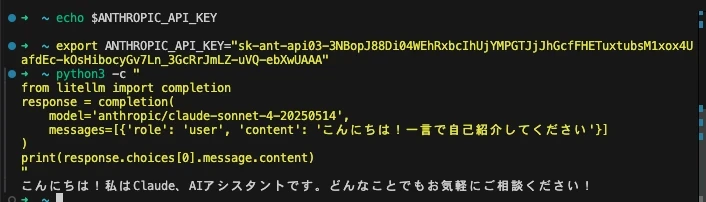

Claude API → 一発成功 ✅

「こんにちは!一言で自己紹介してください」と送ってみたところ、こんな回答が返ってきました。

こんにちは!私はClaude、AIアシスタントです。どんなことでもお気軽にご相談ください!

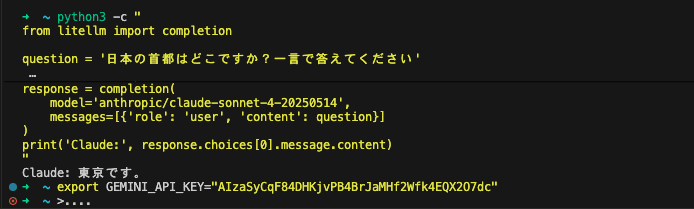

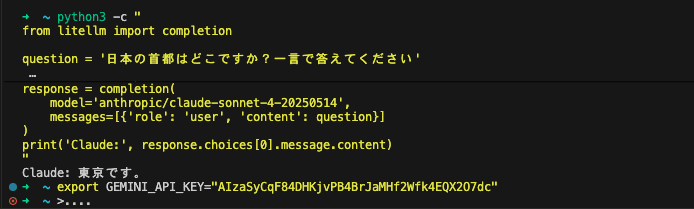

「日本の首都はどこですか?」にも「東京です。」と即答。問題なく動いています。

LiteLLM経由でも遅延は体感ゼロ。間に1枚レイヤーが挟まっている感覚がまったくないのが良いですね。

Gemini API → 接続OK、ただし無料枠の壁 ⚠️

同じ質問をGeminiにも投げてみたのですが、429 Too Many Requests エラーが発生。無料枠のリクエスト上限に引っかかってしまいました。

ただし、これはLiteLLMの問題ではありません。 認証自体は正常に通っているので、Google側の無料枠制限が原因。課金設定をすれば問題なく使えるはずです。

むしろ「ちゃんとGoogleのAPIまで到達している」ことの証明になりました。エラーメッセージすら、ちゃんと動いている証拠というわけです。

検証中の発見:「AIチャット」と「API」はまったくの別モノだった

検証中にひとつ、意外と盲点だった発見がありました。

普段ブラウザで使っているAIチャットと、APIはまったく別のサービスで、料金体系も別。

AIチャット(ブラウザ版) | API | |

|---|---|---|

料金 | 月額定額 | 従量課金(トークン数) |

用途 | 個人での対話 | アプリやシステムへの組み込み |

アカウント | 各サービスのアカウント | 各社の開発者アカウント |

たとえば会社でChatGPTやGeminiのサブスクリプション契約をしていても、API利用は含まれていません。APIは従量課金(使った分だけ請求)で、別途開発者アカウントの登録と課金設定が必要です。

Geminiの無料枠エラーが出たときに「あれ、会社でGemini契約してるのに?」と思ったのですが、APIは別世界の話でした。

これ、エンジニア以外のメンバーにも共有しておきたい知識です。「ChatGPTのサブスク入ってるからAPI使えるよね?」は、あるあるな誤解なので。

これからLiteLLMで何ができるか——顧客向けシステムでの活用シーン

今回は「動くかどうか」の基本検証でしたが、本当に面白いのはここから先です。LiteLLMを実際のお客様向けシステムに組み込んだら何ができるか。具体的なシーンを4つ考えてみました。

💬 AIチャットボット:お客様の業種に合わせて最適なAIを選べる

お客様のWebサイトにAIチャットボットを組み込む案件を想像してください。

LiteLLMなしで「ChatGPTで作りました」と納品したら、もう後戻りできません。途中で「Claudeの方が日本語の精度いいじゃん」となっても、コードの大幅な書き換えが必要です。

LiteLLMなら、model= を変えるだけ。

開発中に複数モデルで精度を比較し、お客様の業種や用途に最適なモデルを選んで納品できます。納品後にもっと良いモデルが出ても、切り替えは1行。

# 医療系のお客様 → 正確性重視でClaude response = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...]) # コスト重視のお客様 → 高速・低コストなGemini Flash response = completion(model='gemini/gemini-2.0-flash', messages=[...])

「お客様ごとに最適なAIを選べるチャットボット」。 これ、LiteLLMなしでは提案しづらいですが、LiteLLMがあれば当たり前のようにできます。

📄 AI議事録・レポート自動生成:1つのシステムで「安いAI」と「賢いAI」を使い分ける

会議の議事録を自動生成するシステムを例に考えてみます。

実は、AIモデルには得意不得意があります。要約が上手いモデル、長文を正確に処理できるモデル、とにかく速いモデル。全部の処理を1つの高性能モデルに任せるのは、品質面でもコスト面でももったいない。

LiteLLMなら、1つのシステムの中でタスクごとにモデルを切り替えられます。

# ステップ1:文字起こしの要約 → 高速・低コストなモデルで十分 summary = completion(model='gemini/gemini-2.0-flash', messages=[...]) # ステップ2:ビジネスレポートとして整形 → 高精度なモデルで丁寧に report = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...])

雑用は安いAI、仕上げは賢いAI。この「適材適所」が、コード上では model= を変えるだけで実現できるわけです。

🔄 24時間止まらないAIサービス:「メインが落ちたら自動で切り替え」

お客様に提供しているAIサービスが、ある日突然止まったら?

AIのAPIは、意外とダウンします。OpenAIが障害を起こしてSNSが騒然となった、なんてニュースは珍しくありません。顧客向けサービスで「AIのAPIが落ちたので動きません」は許されない。

LiteLLMのフォールバック機能を使えば、メインのAIが落ちたら自動で別のAIに切り替えができます。

response = completion( model="openai/gpt-4o", messages=messages, fallbacks=["anthropic/claude-sonnet-4-20250514", "gemini/gemini-pro"] ) # OpenAIが落ちたら → Claude → それも落ちたら → Gemini

お客様には**「複数のAIをバックアップとして用意しているので、1社が障害を起こしても止まりません」**と説明できる。これは大きな安心材料であり、競合との差別化ポイントになります。

💰 API費用を最大90%カット:モデルの価格差を活かす

AIのAPI利用料は、モデルによってびっくりするくらい違います。

モデル | 入力コスト(100万トークンあたり) |

|---|---|

GPT-4o | 約$2.50 |

Claude Sonnet | 約$3.00 |

Gemini Flash | 約$0.10 |

最大30倍の価格差。 全部の処理を高性能モデルに投げていたら、月末の請求書を見て震えることになります。

LiteLLMなら、重要度でモデルを振り分ける設計が簡単にできます。

def smart_completion(question, importance="low"): if importance == "high": # 重要な処理 → 高精度モデル return completion(model="anthropic/claude-sonnet-4-20250514", messages=[...]) else: # 定型処理 → 高速・低コストモデル(30分の1の価格) return completion(model="gemini/gemini-2.0-flash", messages=[...])

「AI利用コストを最大90%削減できる設計にしました」——お客様への提案で、この一言は間違いなく刺さります。

まとめ

LiteLLMは、導入のハードルが極めて低く(pip installとAPIキー設定のみ)、それでいて顧客向けシステムの設計を根本から変えるポテンシャルを持ったライブラリでした。

今回の検証で確認できたのは基本的な動作ですが、その先に見えるのは:

顧客ごとに最適なAIモデルを提案できるチャットボット開発

タスクごとにモデルを使い分ける高品質なAIシステム

24時間止まらないフォールバック付きサービス

API費用を最大90%削減するコスト最適化

model= を1行変えるだけ。たったそれだけのことが、お客様に提案できる価値を大きく変えます。

次にやりたいこと:

Gemini APIの課金設定を有効にしての再テスト

OpenAI GPT-4oとの3社比較検証

フォールバック機能の実地テスト

顧客向けチャットボットのプロトタイプ開発

AIモデルの選択肢が増え続ける今こそ、LiteLLMのような「統一レイヤー」の出番です。

検証環境:Mac (Apple Silicon) / Python 3.13 / LiteLLM v1.81.11 / 2026年2月

VISK株式会社 | AI技術検証レポート

「model=」を1行変えるだけ。ChatGPT・Claude・Geminiを自由に切り替えられるLiteLLMを試してみた

ChatGPT、Claude、Gemini——全部試したいけど、コード書き直すの面倒じゃないですか?

業務でAIを活用しようとすると、「結局どのモデルが一番いいの?」という疑問にぶつかります。OpenAIのGPT-4o、AnthropicのClaude、GoogleのGemini——得意分野もコストも違う。でも各社のSDKもAPIの書き方もバラバラで、比較するだけでもう一仕事。

「model=の文字列を変えるだけで、全部のAIを呼び出せたらいいのに」

それ、できます。

今回検証したのは LiteLLM。100種類以上のAIモデルを統一インターフェースで呼び出せるPythonライブラリです。実際に動かしてみたら、想像以上にシンプルだったので検証結果を共有します。

LiteLLMとは——AIモデルの「方言」を吸収してくれる翻訳機

ひとことで言うと、「1つのコードで100種類以上のAIモデルを呼び出せるPythonライブラリ」 です。オープンソースで無料。pip install litellm で入ります。

何がすごいかというと、AIモデルの切り替えが model= の1箇所を変えるだけで済むこと。

from litellm import completion # Claudeを使う response = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...]) # Geminiに切り替え(変えたのはこの1行だけ) response = completion(model='gemini/gemini-2.0-flash', messages=[...]) # ChatGPTに切り替え(やっぱりこの1行だけ) response = completion(model='openai/gpt-4o', messages=[...])

コードの構造はまったく同じ。変えるのは model= の文字列だけ。

これ、地味に見えて革命的じゃないですか。

セットアップ:5分で終わる(本当に)

やることは2つだけです。

① LiteLLMをインストール

② 使いたいAIのAPIキーを環境変数にセット

export ANTHROPIC_API_KEY="sk-ant-xxxxxxxxxxxxx" export GEMINI_API_KEY="xxxxxxxxxxxxx"

以上。 フレームワークの設定ファイルも、複雑な初期化コードも不要。

💡

exportで設定したAPIキーはターミナルを閉じるとリセットされます。永続化するなら.bashrcや.zshrcに書いておくのがおすすめです。

実際に動かしてみた

Claude API → 一発成功 ✅

「こんにちは!一言で自己紹介してください」と送ってみたところ、こんな回答が返ってきました。

こんにちは!私はClaude、AIアシスタントです。どんなことでもお気軽にご相談ください!

「日本の首都はどこですか?」にも「東京です。」と即答。問題なく動いています。

LiteLLM経由でも遅延は体感ゼロ。間に1枚レイヤーが挟まっている感覚がまったくないのが良いですね。

Gemini API → 接続OK、ただし無料枠の壁 ⚠️

同じ質問をGeminiにも投げてみたのですが、429 Too Many Requests エラーが発生。無料枠のリクエスト上限に引っかかってしまいました。

ただし、これはLiteLLMの問題ではありません。 認証自体は正常に通っているので、Google側の無料枠制限が原因。課金設定をすれば問題なく使えるはずです。

むしろ「ちゃんとGoogleのAPIまで到達している」ことの証明になりました。エラーメッセージすら、ちゃんと動いている証拠というわけです。

検証中の発見:「AIチャット」と「API」はまったくの別モノだった

検証中にひとつ、意外と盲点だった発見がありました。

普段ブラウザで使っているAIチャットと、APIはまったく別のサービスで、料金体系も別。

AIチャット(ブラウザ版) | API | |

|---|---|---|

料金 | 月額定額 | 従量課金(トークン数) |

用途 | 個人での対話 | アプリやシステムへの組み込み |

アカウント | 各サービスのアカウント | 各社の開発者アカウント |

たとえば会社でChatGPTやGeminiのサブスクリプション契約をしていても、API利用は含まれていません。APIは従量課金(使った分だけ請求)で、別途開発者アカウントの登録と課金設定が必要です。

Geminiの無料枠エラーが出たときに「あれ、会社でGemini契約してるのに?」と思ったのですが、APIは別世界の話でした。

これ、エンジニア以外のメンバーにも共有しておきたい知識です。「ChatGPTのサブスク入ってるからAPI使えるよね?」は、あるあるな誤解なので。

これからLiteLLMで何ができるか——顧客向けシステムでの活用シーン

今回は「動くかどうか」の基本検証でしたが、本当に面白いのはここから先です。LiteLLMを実際のお客様向けシステムに組み込んだら何ができるか。具体的なシーンを4つ考えてみました。

💬 AIチャットボット:お客様の業種に合わせて最適なAIを選べる

お客様のWebサイトにAIチャットボットを組み込む案件を想像してください。

LiteLLMなしで「ChatGPTで作りました」と納品したら、もう後戻りできません。途中で「Claudeの方が日本語の精度いいじゃん」となっても、コードの大幅な書き換えが必要です。

LiteLLMなら、model= を変えるだけ。

開発中に複数モデルで精度を比較し、お客様の業種や用途に最適なモデルを選んで納品できます。納品後にもっと良いモデルが出ても、切り替えは1行。

# 医療系のお客様 → 正確性重視でClaude response = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...]) # コスト重視のお客様 → 高速・低コストなGemini Flash response = completion(model='gemini/gemini-2.0-flash', messages=[...])

「お客様ごとに最適なAIを選べるチャットボット」。 これ、LiteLLMなしでは提案しづらいですが、LiteLLMがあれば当たり前のようにできます。

📄 AI議事録・レポート自動生成:1つのシステムで「安いAI」と「賢いAI」を使い分ける

会議の議事録を自動生成するシステムを例に考えてみます。

実は、AIモデルには得意不得意があります。要約が上手いモデル、長文を正確に処理できるモデル、とにかく速いモデル。全部の処理を1つの高性能モデルに任せるのは、品質面でもコスト面でももったいない。

LiteLLMなら、1つのシステムの中でタスクごとにモデルを切り替えられます。

# ステップ1:文字起こしの要約 → 高速・低コストなモデルで十分 summary = completion(model='gemini/gemini-2.0-flash', messages=[...]) # ステップ2:ビジネスレポートとして整形 → 高精度なモデルで丁寧に report = completion(model='anthropic/claude-sonnet-4-20250514', messages=[...])

雑用は安いAI、仕上げは賢いAI。この「適材適所」が、コード上では model= を変えるだけで実現できるわけです。

🔄 24時間止まらないAIサービス:「メインが落ちたら自動で切り替え」

お客様に提供しているAIサービスが、ある日突然止まったら?

AIのAPIは、意外とダウンします。OpenAIが障害を起こしてSNSが騒然となった、なんてニュースは珍しくありません。顧客向けサービスで「AIのAPIが落ちたので動きません」は許されない。

LiteLLMのフォールバック機能を使えば、メインのAIが落ちたら自動で別のAIに切り替えができます。

response = completion( model="openai/gpt-4o", messages=messages, fallbacks=["anthropic/claude-sonnet-4-20250514", "gemini/gemini-pro"] ) # OpenAIが落ちたら → Claude → それも落ちたら → Gemini

お客様には**「複数のAIをバックアップとして用意しているので、1社が障害を起こしても止まりません」**と説明できる。これは大きな安心材料であり、競合との差別化ポイントになります。

💰 API費用を最大90%カット:モデルの価格差を活かす

AIのAPI利用料は、モデルによってびっくりするくらい違います。

モデル | 入力コスト(100万トークンあたり) |

|---|---|

GPT-4o | 約$2.50 |

Claude Sonnet | 約$3.00 |

Gemini Flash | 約$0.10 |

最大30倍の価格差。 全部の処理を高性能モデルに投げていたら、月末の請求書を見て震えることになります。

LiteLLMなら、重要度でモデルを振り分ける設計が簡単にできます。

def smart_completion(question, importance="low"): if importance == "high": # 重要な処理 → 高精度モデル return completion(model="anthropic/claude-sonnet-4-20250514", messages=[...]) else: # 定型処理 → 高速・低コストモデル(30分の1の価格) return completion(model="gemini/gemini-2.0-flash", messages=[...])

「AI利用コストを最大90%削減できる設計にしました」——お客様への提案で、この一言は間違いなく刺さります。

まとめ

LiteLLMは、導入のハードルが極めて低く(pip installとAPIキー設定のみ)、それでいて顧客向けシステムの設計を根本から変えるポテンシャルを持ったライブラリでした。

今回の検証で確認できたのは基本的な動作ですが、その先に見えるのは:

顧客ごとに最適なAIモデルを提案できるチャットボット開発

タスクごとにモデルを使い分ける高品質なAIシステム

24時間止まらないフォールバック付きサービス

API費用を最大90%削減するコスト最適化

model= を1行変えるだけ。たったそれだけのことが、お客様に提案できる価値を大きく変えます。

次にやりたいこと:

Gemini APIの課金設定を有効にしての再テスト

OpenAI GPT-4oとの3社比較検証

フォールバック機能の実地テスト

顧客向けチャットボットのプロトタイプ開発

AIモデルの選択肢が増え続ける今こそ、LiteLLMのような「統一レイヤー」の出番です。

検証環境:Mac (Apple Silicon) / Python 3.13 / LiteLLM v1.81.11 / 2026年2月

VISK株式会社 | AI技術検証レポート