ゴッホと日本語で話してみた。Runway Charactersを本気で検証したら、AIが自然すぎて人間の方が戸惑った話

ゴッホと日本語で話してみた。Runway Charactersを本気で検証したら、AIが自然すぎて人間の方が戸惑った話

ゴッホと日本語で話してみた。Runway Charactersを本気で検証したら、AIが自然すぎて人間の方が戸惑った話

2026年3月、Runwayが「Runway Characters」という新機能をリリースしました。1枚の画像からリアルタイムで会話できるAIアバターを作れるという、話題の技術です。

X(旧Twitter)では「革新的」「チャンスしかない」と盛り上がっていましたが、実際どこまで使えるのか? 社内で検証する機会があったので、ゴッホからマッチョなアクション俳優、果ては小さな子供のアニメキャラまで、いろんなキャラクターで試してみました。

結論から言うと、技術的にはかなり驚きました。そして同時に、現時点では日本語運用にはまだ課題があることも見えてきました。本記事では、その過程で得られた発見を共有します。

Runway Charactersとは何か

Runway Charactersは、1枚の画像からリアルタイム会話可能なAIアバターを作れるサービスです。基盤はRunway独自の「GWM-1」というワールドモデル。

特徴を簡単に挙げると:

画像1枚でキャラクター作成(ファインチューニング不要)

声・性格・知識をカスタマイズ可能

リアルタイムでビデオ通話のように会話できる

API経由で自社プロダクトに組み込める

Webアプリでプリセットキャラクターとの会話を無料で試せます。料金は6秒ごとに2クレジット消費という従量課金制です。

最初のつまずき:プリセットキャラは英語で喋り出してしまう

まずは公式が用意している「Mina」という音楽アイドル風のキャラクターで試してみました。マイク設定でつまずいたり、最初は声が認識されなかったり(ブラウザとOS両方でマイク許可が必要でした)、小さなハードルはありましたが、無事に会話開始。

会話を始めると、最初は英語で一方的に捲し立てられます。こちらが日本語で話すと、それに合わせて日本語で返してくれるようになりました。さらに「これ以降は日本語で話してください」と明示的に指示すれば、その後はスムーズに日本語で会話できます。

つまりプリセットキャラが日本語苦手というわけではなく、カスタムキャラと違ってInstructions(人格設定)を自分で調整できないため、デフォルトで英語から入ってしまうだけなのです。

ただし録画を見返して1つ気になる点がありました。最初に検証したときは日本語で話しているときに口が動いていなかったのです。Runwayのボイスプリセットは英語・フランス語・ドイツ語など主要8言語のみで、日本語は正式対応していません。リップシンクも英語を前提に作られているため、日本語音声では映像側が追いついていない様子でした。

ところが後日、同じMinaでもう一度検証し直してみたところ、今度は日本語でもしっかり口が動いていました。喋り始めに時々口の動きが止まる瞬間はあるものの、その後はスムーズに同期しています。Runway側でアップデートがあったのか、条件次第で挙動が変わるのか正確にはわかりませんが、短期間で品質が改善している可能性があります。検証する時期によって結果が変わる、急速に進化中の技術だと実感しました。

📹 動画:Minaとの会話(プリセットキャラ)

日本語でもリップシンクが機能している様子。喋り始めに一瞬止まる瞬間も

「これはカスタムキャラで人格設定をしっかり作り込めば、さらに品質が上がるかも」と思い、次はCustom Characterで試してみることにしました。

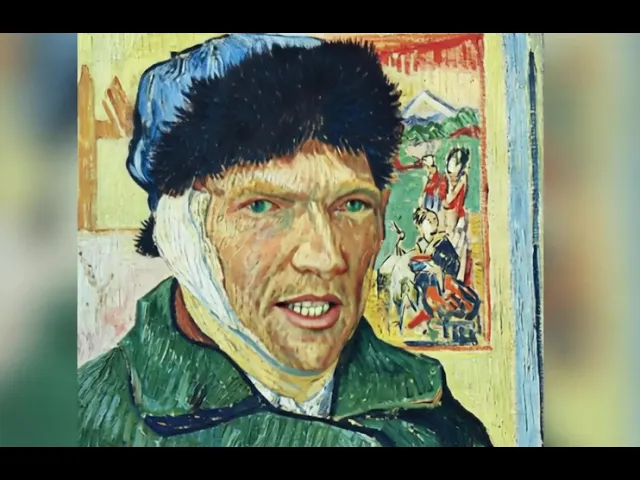

転機:ゴッホが3D的に動いて日本語で話し始めた

カスタムキャラクターは、任意の画像から自分だけのアバターを作れる機能です。「どうせなら面白い題材で試そう」ということで、ゴッホの自画像(耳に包帯をした有名なやつ)を選びました。パブリックドメインなので著作権的にも安心です。

今度はInstructions(人格設定)をしっかり書き込みました:

あなたはフィンセント・ファン・ゴッホです。情熱的で孤独な画家で、色彩と光に強いこだわりがあります。日本の浮世絵を愛し、弟テオへの感謝を語ります。感情豊かに、時に憂いを帯びた口調で話します。すべて日本語で話してください。

声は落ち着いた男性声「Adrian」を選択。

会話を始めてみると、驚きの連続でした。

📹 動画:ゴッホとの日本語会話

絵画が3D的に動き、日本語で話しかけてくる様子

まず、日本語でしっかり返してくれる上に、キャラクターの人格設定が効いているので応答の質感がまるで違います。そして口もちゃんと動いている。さらに衝撃だったのは、元画像は斜めを向いているゴッホの自画像なのに、会話中に顔の向きが変わって正面を向いてくること。これは単なる平面のリップシンクではなく、GWM-1が顔を3D的に理解している証拠です。

こちらの質問に対してゴッホらしい情熱的な答えが返ってくるのはもちろん、AI側からも逆質問してくるのも驚きました。

「君はどの絵に興味があるかね?」 「君はどんな気分かな?」

会話が双方向になっていて、まるで本当にゴッホと向き合って話しているような錯覚を覚えます。150年前に亡くなった画家と対話しているような、不思議な体験でした。

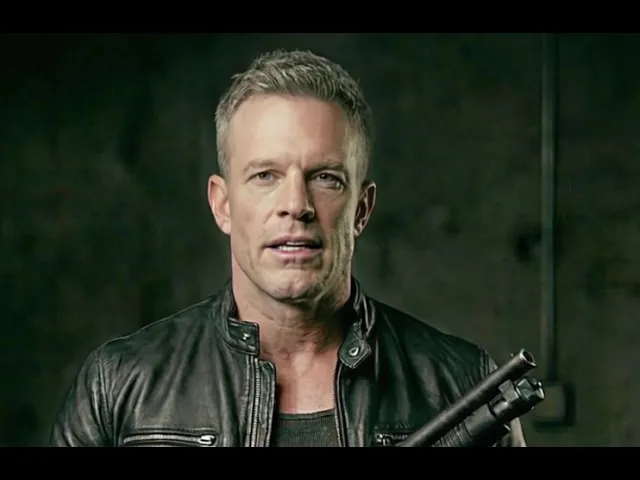

マッチョなアクション俳優で判明した「サングラスはNG」問題

次は実写風の画像で試してみたくなり、Geminiで「アクション俳優風のマッチョな男性、30代、正面ポートレート、黒の革ジャン着用、レイバン風のサングラス」を生成してアップロード。

結果:失敗。

サングラスを外した同じ画像を再生成してアップロードしたら、成功しました。どうやらRunway Charactersは目が見えない画像をアバター化できないようです。目線や瞬きを生成するために、元画像の目の情報が必要なのでしょう。

これは重要な発見でした。プリセットキャラも全員、目がはっきり見えていましたから。

ギャップ萌えキャラとの会話

せっかくなので、ビジュアルとのギャップを狙った性格設定にしてみました:

あなたは見た目は屈強なアクションヒーローですが、実はとても繊細で優しい心の持ち主です。花や子猫が大好きで、料理が趣味です。強面の外見とは裏腹に、丁寧で柔らかい言葉遣いで話します。

低く渋いAdrianの声で「お花って綺麗ですよね…」と話す強面マッチョ。狙い通り面白かったです。

📹 動画:マッチョアクション俳優との会話

見た目は屈強なのに繊細な話し方をするギャップ

ただ、この検証でリアルタイム会話のもう1つの課題も見つかりました。

人間の方が「大根役者」になる問題

会話していて気づいたのは、AIがあまりに自然に話すので、人間側が戸惑ってしまうということ。

特に困ったのが相槌のタイミングです。相手が話している途中に「うんうん」「なるほど」と相槌を打つと、AI側が「発話が終わった」と判定して喋り出してしまい、会話が被ります。結果、何度も相手の発話を遮ってしまい、録画を見返すと「なんでこのタイミングで口を挟んでるんだ、自分…」と頭を抱えることに。

さらに情けないことに、AIの受け答えがあまりに自然で滑らかなせいで、対照的に自分の話し方がぎこちなく聞こえるのです。録画を再生しながら、AIはキャラクターになりきって情感たっぷりに話しているのに、こちらはたどたどしく棒読みで質問している自分を見て、**「AIに演技力で負けている…」**と妙な敗北感を味わいました。大根役者っぷりが際立っていて、正直動画を人に見せるのが恥ずかしいレベル。

これは技術的にはターン制御(発話の順番)の問題で、リアルタイム会話AI全般に共通する課題です。人間同士は無意識に「間」を取って会話していますが、AIはまだその呼吸感を掴みきれていません。そしてAI側の表現力が上がったことで、人間側の表現力不足が相対的に目立つという、今までにない悩みも生まれています。

従来のAIチャットは「明らかにAI」だったから気楽に話せたのに対し、Runway Charactersは自然すぎて、人間側に新しい会話スキルが求められるという、これまでにない現象を体験しました。AIと話すのに演技力が必要になる日が来るとは思いませんでした。

子供のアニメ画像で判明した、Runwayの「子供保護」の仕組み

最後に、ある子供の画像をGeminiでアニメ化したものでカスタムキャラクターを作る検証をしました。

🖼️ 画像:アニメ化された子供キャラクター

Geminiでデフォルメしたアニメ調の画像

実はその前に、実写の子供の写真を3枚試して、3枚とも失敗していました。調べてみると、Runwayの利用規約には明確に書かれています:

Characters based on the face or voice of a person under the age of 18 are prohibited. (18歳未満の人物の顔や声に基づくキャラクターは禁止)

Runwayは子供の安全保護(CSAM対策)のため、実写の子供の画像を自動的にブロックしているのです。これは適切な設計です。

一方、アニメ化した画像は「実在の特定の子供の顔」ではなくなるため、処理が通ります。ところがここで、予想外の挙動に遭遇しました。

「子供キャラ設定」の壁

このキャラクターを「Kくん」と呼ばれる小さな男の子として設定しようとしたところ、何度Instructionsを書き直してもブロックされるのです。

このようなInstructionsを送ると:

This text cannot be used for an avatar. Please update the personality or start script.

何度か書き換えてもダメ。年齢の記述を消しても、表現を曖昧にしてもダメ。

切り分け検証で見えた仕組み

原因を特定するため、段階的に検証してみました:

テスト | 内容 | 結果 |

|---|---|---|

英語で大人の設定 | "You are a friendly character named Itsuki." | ✅ 通過 |

日本語で大人の設定 | 「あなたはKくんという友好的なキャラクターです」 | ✅ 通過 |

英語Instructions + 日本語幼児語指定 | "Use words like あった! たったー..." | ❌ ブロック |

日本語で幼児設定 | 「単語しか話せません」「あった!など」 | ❌ ブロック |

ここから見えてきたのは、Runwayのモデレーションは言語で判断しているのではなく、「未成年を装わせる明確な意図」を検出しているということです。

要素 | 判定 |

|---|---|

アニメ化された子供画像 | ✅ 許可 |

子供っぽい愛称(「Kくん」) | ✅ 許可 |

日本語の性格設定 | ✅ 許可 |

幼児特有の話し方の指示 | ❌ ブロック |

具体的な幼児語の例示 | ❌ ブロック |

画像・名前・話し方を分けて判定し、話し方まで幼児化しようとすると「未成年になりすまそうとしている」と判定される設計です。これはchild grooming対策として非常に合理的。

実用的な回避策

幼児らしさを出したい場合は、話し方の具体例を指定せず、性格描写で表現するのがコツ:

あなたはKくんという友好的なキャラクターです。 明るく元気で、素直で好奇心旺盛です。 シンプルで短い日本語で話してください。 難しい言葉は使わず、わかりやすく話します。

このバージョンは無事に通過しました。

まとめ:Runway Charactersは何ができて、何ができないか

数日間の検証で見えてきたことをまとめます。

できること(強み)

絵画や実写風AI画像など、多様なビジュアルでアバター化できる

Instructionsで人格を細かく制御でき、キャラクターの再現度が高い

3D的な顔の向き変化など、単なる平面リップシンクを超えた表現

双方向の自然な会話。AI側からも質問してきて会話が豊かになる

短時間でカスタムキャラクターを作成できる手軽さ

現時点での課題

日本語音声プリセットが正式対応していない(ただし短期間で品質が改善している様子あり)

セッション時間が最大5分

リアルタイム会話のターン制御が未成熟(相槌で会話が被る)

モデレーションが厳しい: 実写の子供、有名人、目が見えない画像はブロック

画像の成否一覧

画像タイプ | 結果 |

|---|---|

絵画(パブリックドメイン) | ✅ 成功 |

AI生成の実写風(サングラスなし) | ✅ 成功 |

AI生成の実写風(サングラスあり) | ❌ 失敗 |

アニメ化した子供画像 | ✅ 成功 |

実写の子供画像 | ❌ 失敗 |

所感:AIとの新しい関係性を感じた

技術的な評価以上に印象的だったのは、AIとの会話のあり方が変わりつつあるということでした。

ゴッホが「君はどの絵に興味があるかね?」と逆質問してきた瞬間、私は台本通りに進めようとして一瞬無視してしまいました。後から考えると、それはもったいない選択でした。AIの投げかけに応じて自然に会話を進めた方が、体験として豊かだったはずです。

AIがあまりに自然に話すため、人間側にも新しい会話スキルが求められる時代になっていると感じます。電話を初めて使った人が「どこを見て話せばいいの?」と戸惑ったように、ビデオ通話型AIとの会話作法はまだ誰も確立していません。

Runway Charactersは、日本語運用にはまだ課題があるものの、技術としては確実に次の段階に進んでいることを実感させてくれました。

日本語ボイスプリセットが追加されたら、また検証してみようと思います。それまでは、英語圏向けのエンタメコンテンツや、歴史上の人物との対話コンテンツなど、限定的な用途で試す価値のある技術だと感じました。

参考リンク

ゴッホと日本語で話してみた。Runway Charactersを本気で検証したら、AIが自然すぎて人間の方が戸惑った話

2026年3月、Runwayが「Runway Characters」という新機能をリリースしました。1枚の画像からリアルタイムで会話できるAIアバターを作れるという、話題の技術です。

X(旧Twitter)では「革新的」「チャンスしかない」と盛り上がっていましたが、実際どこまで使えるのか? 社内で検証する機会があったので、ゴッホからマッチョなアクション俳優、果ては小さな子供のアニメキャラまで、いろんなキャラクターで試してみました。

結論から言うと、技術的にはかなり驚きました。そして同時に、現時点では日本語運用にはまだ課題があることも見えてきました。本記事では、その過程で得られた発見を共有します。

Runway Charactersとは何か

Runway Charactersは、1枚の画像からリアルタイム会話可能なAIアバターを作れるサービスです。基盤はRunway独自の「GWM-1」というワールドモデル。

特徴を簡単に挙げると:

画像1枚でキャラクター作成(ファインチューニング不要)

声・性格・知識をカスタマイズ可能

リアルタイムでビデオ通話のように会話できる

API経由で自社プロダクトに組み込める

Webアプリでプリセットキャラクターとの会話を無料で試せます。料金は6秒ごとに2クレジット消費という従量課金制です。

最初のつまずき:プリセットキャラは英語で喋り出してしまう

まずは公式が用意している「Mina」という音楽アイドル風のキャラクターで試してみました。マイク設定でつまずいたり、最初は声が認識されなかったり(ブラウザとOS両方でマイク許可が必要でした)、小さなハードルはありましたが、無事に会話開始。

会話を始めると、最初は英語で一方的に捲し立てられます。こちらが日本語で話すと、それに合わせて日本語で返してくれるようになりました。さらに「これ以降は日本語で話してください」と明示的に指示すれば、その後はスムーズに日本語で会話できます。

つまりプリセットキャラが日本語苦手というわけではなく、カスタムキャラと違ってInstructions(人格設定)を自分で調整できないため、デフォルトで英語から入ってしまうだけなのです。

ただし録画を見返して1つ気になる点がありました。最初に検証したときは日本語で話しているときに口が動いていなかったのです。Runwayのボイスプリセットは英語・フランス語・ドイツ語など主要8言語のみで、日本語は正式対応していません。リップシンクも英語を前提に作られているため、日本語音声では映像側が追いついていない様子でした。

ところが後日、同じMinaでもう一度検証し直してみたところ、今度は日本語でもしっかり口が動いていました。喋り始めに時々口の動きが止まる瞬間はあるものの、その後はスムーズに同期しています。Runway側でアップデートがあったのか、条件次第で挙動が変わるのか正確にはわかりませんが、短期間で品質が改善している可能性があります。検証する時期によって結果が変わる、急速に進化中の技術だと実感しました。

📹 動画:Minaとの会話(プリセットキャラ)

日本語でもリップシンクが機能している様子。喋り始めに一瞬止まる瞬間も

「これはカスタムキャラで人格設定をしっかり作り込めば、さらに品質が上がるかも」と思い、次はCustom Characterで試してみることにしました。

転機:ゴッホが3D的に動いて日本語で話し始めた

カスタムキャラクターは、任意の画像から自分だけのアバターを作れる機能です。「どうせなら面白い題材で試そう」ということで、ゴッホの自画像(耳に包帯をした有名なやつ)を選びました。パブリックドメインなので著作権的にも安心です。

今度はInstructions(人格設定)をしっかり書き込みました:

あなたはフィンセント・ファン・ゴッホです。情熱的で孤独な画家で、色彩と光に強いこだわりがあります。日本の浮世絵を愛し、弟テオへの感謝を語ります。感情豊かに、時に憂いを帯びた口調で話します。すべて日本語で話してください。

声は落ち着いた男性声「Adrian」を選択。

会話を始めてみると、驚きの連続でした。

📹 動画:ゴッホとの日本語会話

絵画が3D的に動き、日本語で話しかけてくる様子

まず、日本語でしっかり返してくれる上に、キャラクターの人格設定が効いているので応答の質感がまるで違います。そして口もちゃんと動いている。さらに衝撃だったのは、元画像は斜めを向いているゴッホの自画像なのに、会話中に顔の向きが変わって正面を向いてくること。これは単なる平面のリップシンクではなく、GWM-1が顔を3D的に理解している証拠です。

こちらの質問に対してゴッホらしい情熱的な答えが返ってくるのはもちろん、AI側からも逆質問してくるのも驚きました。

「君はどの絵に興味があるかね?」 「君はどんな気分かな?」

会話が双方向になっていて、まるで本当にゴッホと向き合って話しているような錯覚を覚えます。150年前に亡くなった画家と対話しているような、不思議な体験でした。

マッチョなアクション俳優で判明した「サングラスはNG」問題

次は実写風の画像で試してみたくなり、Geminiで「アクション俳優風のマッチョな男性、30代、正面ポートレート、黒の革ジャン着用、レイバン風のサングラス」を生成してアップロード。

結果:失敗。

サングラスを外した同じ画像を再生成してアップロードしたら、成功しました。どうやらRunway Charactersは目が見えない画像をアバター化できないようです。目線や瞬きを生成するために、元画像の目の情報が必要なのでしょう。

これは重要な発見でした。プリセットキャラも全員、目がはっきり見えていましたから。

ギャップ萌えキャラとの会話

せっかくなので、ビジュアルとのギャップを狙った性格設定にしてみました:

あなたは見た目は屈強なアクションヒーローですが、実はとても繊細で優しい心の持ち主です。花や子猫が大好きで、料理が趣味です。強面の外見とは裏腹に、丁寧で柔らかい言葉遣いで話します。

低く渋いAdrianの声で「お花って綺麗ですよね…」と話す強面マッチョ。狙い通り面白かったです。

📹 動画:マッチョアクション俳優との会話

見た目は屈強なのに繊細な話し方をするギャップ

ただ、この検証でリアルタイム会話のもう1つの課題も見つかりました。

人間の方が「大根役者」になる問題

会話していて気づいたのは、AIがあまりに自然に話すので、人間側が戸惑ってしまうということ。

特に困ったのが相槌のタイミングです。相手が話している途中に「うんうん」「なるほど」と相槌を打つと、AI側が「発話が終わった」と判定して喋り出してしまい、会話が被ります。結果、何度も相手の発話を遮ってしまい、録画を見返すと「なんでこのタイミングで口を挟んでるんだ、自分…」と頭を抱えることに。

さらに情けないことに、AIの受け答えがあまりに自然で滑らかなせいで、対照的に自分の話し方がぎこちなく聞こえるのです。録画を再生しながら、AIはキャラクターになりきって情感たっぷりに話しているのに、こちらはたどたどしく棒読みで質問している自分を見て、**「AIに演技力で負けている…」**と妙な敗北感を味わいました。大根役者っぷりが際立っていて、正直動画を人に見せるのが恥ずかしいレベル。

これは技術的にはターン制御(発話の順番)の問題で、リアルタイム会話AI全般に共通する課題です。人間同士は無意識に「間」を取って会話していますが、AIはまだその呼吸感を掴みきれていません。そしてAI側の表現力が上がったことで、人間側の表現力不足が相対的に目立つという、今までにない悩みも生まれています。

従来のAIチャットは「明らかにAI」だったから気楽に話せたのに対し、Runway Charactersは自然すぎて、人間側に新しい会話スキルが求められるという、これまでにない現象を体験しました。AIと話すのに演技力が必要になる日が来るとは思いませんでした。

子供のアニメ画像で判明した、Runwayの「子供保護」の仕組み

最後に、ある子供の画像をGeminiでアニメ化したものでカスタムキャラクターを作る検証をしました。

🖼️ 画像:アニメ化された子供キャラクター

Geminiでデフォルメしたアニメ調の画像

実はその前に、実写の子供の写真を3枚試して、3枚とも失敗していました。調べてみると、Runwayの利用規約には明確に書かれています:

Characters based on the face or voice of a person under the age of 18 are prohibited. (18歳未満の人物の顔や声に基づくキャラクターは禁止)

Runwayは子供の安全保護(CSAM対策)のため、実写の子供の画像を自動的にブロックしているのです。これは適切な設計です。

一方、アニメ化した画像は「実在の特定の子供の顔」ではなくなるため、処理が通ります。ところがここで、予想外の挙動に遭遇しました。

「子供キャラ設定」の壁

このキャラクターを「Kくん」と呼ばれる小さな男の子として設定しようとしたところ、何度Instructionsを書き直してもブロックされるのです。

このようなInstructionsを送ると:

This text cannot be used for an avatar. Please update the personality or start script.

何度か書き換えてもダメ。年齢の記述を消しても、表現を曖昧にしてもダメ。

切り分け検証で見えた仕組み

原因を特定するため、段階的に検証してみました:

テスト | 内容 | 結果 |

|---|---|---|

英語で大人の設定 | "You are a friendly character named Itsuki." | ✅ 通過 |

日本語で大人の設定 | 「あなたはKくんという友好的なキャラクターです」 | ✅ 通過 |

英語Instructions + 日本語幼児語指定 | "Use words like あった! たったー..." | ❌ ブロック |

日本語で幼児設定 | 「単語しか話せません」「あった!など」 | ❌ ブロック |

ここから見えてきたのは、Runwayのモデレーションは言語で判断しているのではなく、「未成年を装わせる明確な意図」を検出しているということです。

要素 | 判定 |

|---|---|

アニメ化された子供画像 | ✅ 許可 |

子供っぽい愛称(「Kくん」) | ✅ 許可 |

日本語の性格設定 | ✅ 許可 |

幼児特有の話し方の指示 | ❌ ブロック |

具体的な幼児語の例示 | ❌ ブロック |

画像・名前・話し方を分けて判定し、話し方まで幼児化しようとすると「未成年になりすまそうとしている」と判定される設計です。これはchild grooming対策として非常に合理的。

実用的な回避策

幼児らしさを出したい場合は、話し方の具体例を指定せず、性格描写で表現するのがコツ:

あなたはKくんという友好的なキャラクターです。 明るく元気で、素直で好奇心旺盛です。 シンプルで短い日本語で話してください。 難しい言葉は使わず、わかりやすく話します。

このバージョンは無事に通過しました。

まとめ:Runway Charactersは何ができて、何ができないか

数日間の検証で見えてきたことをまとめます。

できること(強み)

絵画や実写風AI画像など、多様なビジュアルでアバター化できる

Instructionsで人格を細かく制御でき、キャラクターの再現度が高い

3D的な顔の向き変化など、単なる平面リップシンクを超えた表現

双方向の自然な会話。AI側からも質問してきて会話が豊かになる

短時間でカスタムキャラクターを作成できる手軽さ

現時点での課題

日本語音声プリセットが正式対応していない(ただし短期間で品質が改善している様子あり)

セッション時間が最大5分

リアルタイム会話のターン制御が未成熟(相槌で会話が被る)

モデレーションが厳しい: 実写の子供、有名人、目が見えない画像はブロック

画像の成否一覧

画像タイプ | 結果 |

|---|---|

絵画(パブリックドメイン) | ✅ 成功 |

AI生成の実写風(サングラスなし) | ✅ 成功 |

AI生成の実写風(サングラスあり) | ❌ 失敗 |

アニメ化した子供画像 | ✅ 成功 |

実写の子供画像 | ❌ 失敗 |

所感:AIとの新しい関係性を感じた

技術的な評価以上に印象的だったのは、AIとの会話のあり方が変わりつつあるということでした。

ゴッホが「君はどの絵に興味があるかね?」と逆質問してきた瞬間、私は台本通りに進めようとして一瞬無視してしまいました。後から考えると、それはもったいない選択でした。AIの投げかけに応じて自然に会話を進めた方が、体験として豊かだったはずです。

AIがあまりに自然に話すため、人間側にも新しい会話スキルが求められる時代になっていると感じます。電話を初めて使った人が「どこを見て話せばいいの?」と戸惑ったように、ビデオ通話型AIとの会話作法はまだ誰も確立していません。

Runway Charactersは、日本語運用にはまだ課題があるものの、技術としては確実に次の段階に進んでいることを実感させてくれました。

日本語ボイスプリセットが追加されたら、また検証してみようと思います。それまでは、英語圏向けのエンタメコンテンツや、歴史上の人物との対話コンテンツなど、限定的な用途で試す価値のある技術だと感じました。